Визуальный инспектор аудиографов на Web Audio API: мотивация создания, детали реализации и размышления о стандарте

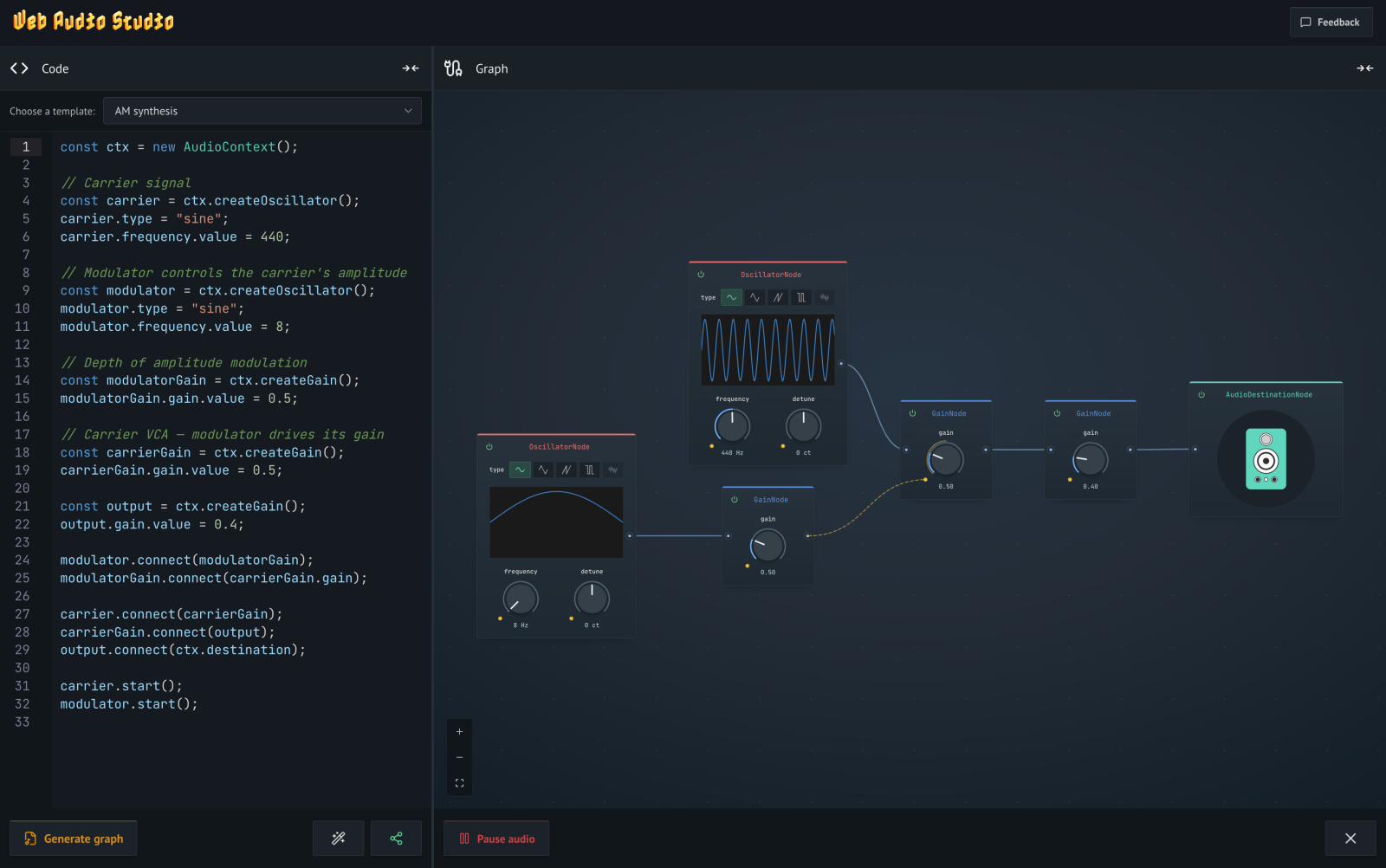

Привет! Недавно я запустил проект Web Audio Studio — интерактивную платформу для визуализации и исследования графов Web Audio API прямо в браузере. В этой статье я хочу поделиться историей разработки, техническими деталями и особо интересными инженерными вызовами, с которыми я столкнулся в процессе создания этого проекта. Кроме того, я выскажу свои мысли о Web Audio API, о том, почему этот стандарт недооценен у веб-разработчиков и что с этим можно сделать (спойлер: во многом ему не хватает хорошего инструментария для разработки и отладки).

Как появилась идея проекта

Впервые мой интерес к стандарту Web Audio API (WAA) проявился ещё в 2011-ом году — на самой заре его появления в браузерах. Стандарт предлагал инструменты для полноценного синтеза и обработки звука в вебе. На тот момент эти возможности существовали только в профессиональных десктопных DAW (digital audio workstation) типа Ableton Live, Logic Pro, FL Studio и других. Появление таких возможностей превращало веб в полноценную среду для работы со звуком — разработки игр, музыкальных приложений и креативного программирования. Всё это совпадало с моими увлечениями, поэтому интерес к стандарту возник сам собой.

Основная идея работы со звуком в Web Audio API заключается в построении аудиографов — схем потока аудиосигнала от источника до конечной точки назначения (обычно до колонок или наушников пользователя). Сигнал проходит через цепочку узлов обработки, каждый из которых меняет его характеристики и звучание. Пятнадцать лет назад эта ментальная модель казалась мне одновременно новой, сложной и невероятно интересной. Я пытался экспериментировать с API, но быстро упирался в высокий порог входа в синтез и цифровую обработку звука (DSP). Мне хотелось как-то потрогать аудиограф, увидеть то, что я привык видеть в профессиональных DAW, однако инструментов для этого не было. При отладке приходилось ориентироваться на слух, на console.log и вручную отслеживать соединения между узлами, модуляции, автоматизации и тайминг проигрывания. И это лишь верхушка DSP-айсберга, доступного в Web Audio API и до сих пор довольно сложного для практической отладки.

Тогда мне хотелось, чтобы существовал инструмент, который генерирует интерактивный граф прямо из кода и позволяет исследовать его, менять параметры и сразу слышать результат. Со временем появилось множество любительских проектов с визуальной сборкой аудиографов, но они не позволяли проверить собственный код и почти никак не помогали в реальной разработке. Web Audio Studio устроен иначе: вы пишете обычный JavaScript-код и можете сгенерировать интерактивный аудиограф, где каждый узел имеет собственную визуализацию, контролы параметров и прямой маппинг на соответствующие AudioParam в WAA (1:1).

Сейчас в приложении поддержаны практически все узлы, описанные в спецификации Web Audio API, за исключением двух узлов для работы с многоканальным звуком и AudioWorkletNode, с помощью которой можно писать собственную DSP-логику в отдельном аудиоворкере. Работа над ними уже ведётся, и поддержка появится в будущих версиях.

Однако лучше расскажу не о том, чего в WAS пока нет, а о том, что в нём уже есть:

-

редактор кода с подсветкой, форматированием кода и выводом ошибок;

-

визуальный аудиограф с отображением практически всех доступных в WAA аудиоузлов на канвасе;

-

маппинг аудиопараметров 1:1 — никаких лишних абстракций, только реальные параметры Web Audio API;

-

поддержка модуляций аудиопараметров;

-

возможность в реальном времени менять параметры и сразу слышать, как меняется сигнал;

-

возможность проанализировать аудиосигнал в любом месте графа, вставив

AnalyserNodeмежду двумя узлами; -

встроенная визуализация аудиопроцессов в основных узлах: фильтрах, ревербераторах, компрессорах и других;

-

20 готовых шаблонов кода для демонстрации ключевых возможностей Web Audio API.

Детали реализации Web Audio Studio

Хочу поделиться наиболее интересными инженерными вызовами, с которыми я столкнулся при разработке приложения. Начну с того, как устроена генерация аудиографа в Web Audio Studio.

Web Audio API не предоставляет возможностей получить информацию о графе и его структуре напрямую. Аудиограф запускается и играет в рантайме, поэтому для построения модели графа из кода можно воспользоваться двумя подходами:

-

Сформировать модель графа из результатов анализа синтаксического дерева (AST-анализ кода);

-

Построить модель графа в рантайме через monkey patching интерфейсов и методов WAA.

Первый вариант выглядит логичным: необходимо разобрать код через AST, найти участки кода, отвечающие за создание узлов и вызовы connect(), восстановить предполагаемую топологию графа. Но на практике такой подход может дать лишь статическую, «сухую» модель. Он не позволит получать актуальное состояние системы во времени и как-либо влиять на состояние узлов аудиографа, пока тот играет в браузере.

В Web Audio Studio я сразу пошёл по второму пути и реализовал слой патчей всех прототипов, методов и классов Web Audio API, которые перехватывают создание аудиоузлов и связей между ними и отображают их в модели графа. При этом в модели сохраняются ссылки на реальные инстансы этих узлов в играющем аудиографе. Таким образом можно не только видеть структуру графа, но и читать актуальные значения параметров, отслеживать изменения и взаимодействовать с системой динамически.

Каждый стандартный метод создания ноды оборачивается в прокси-интерфейс, который после вызова оригинального метода регистрирует созданную ноду в модели графа:

// Упрощённый пример патча стандартных методов AudioContext.

const original = AudioContext.prototype.createOscillator;

AudioContext.prototype.createOscillator = function (...args) {

const node = original.apply(this, args);

addNodeToGraph(node, "OscillatorNode");

return node;

};

Аналогичным образом патчится connect() — ключевой метод, через который строятся связи между узлами:

const nativeConnect = AudioNode.prototype.connect;

AudioNode.prototype.connect = function (dest, ...args) {

if (dest instanceof AudioNode) {

addEdgeToGraph(this, dest); // node -> node

} else if (dest instanceof AudioParam) {

addParamEdgeToGraph(this, dest); // node -> param (модуляция)

}

return nativeConnect.call(this, dest, ...args);

};

Когда пользователь пишет в коде строчку osc.connect(gain).connect(ctx.destination), каждый вызов connect() записывается как ребро в модель графа, а на выходе мы получаем полную топологию, которую можно визуализировать.

Запуск пользовательского кода в песочнице

Пользовательский код, из которого строится модель графа, запускается в iframe-песочнице. Это сделано из двух соображений:

-

для безопасности (чтобы код пользователя не мог сломать код приложения или причинить вред через доступ к удалённым ресурсам);

-

для инкапсуляции всех патчей стандартных прототипов Web Audio API (чтобы они не влияли на чистоту движка в основном приложении).

Кстати, перед тем как приступить к разработке песочницы для Web Audio Studio, я глубоко заинтересовался темой браузерной изоляции и написал обширное исследование на эту тему, его можно также почитать в статье «Руководство по архитектуре браузерных песочниц: как работает изоляция JavaScript-кода» .

В итоге, основной поток выполнения в Web Audio Studio выглядит так:

-

пользователь пишет код в редакторе и запускает его →

-

основное приложение посылает сообщение в iframe-песочницу, в которой заранее пропатчены прототипы WAA →

-

песочница получает сообщение, валидирует код на наличие ошибок и, если ошибок нет, запускает его через

new Function(code)→ -

благодаря пропатченным прототипам песочница собирает модель графа, экстрактируя аудиопараметры и нормализируя их для будущего отображения на канвасе →

-

далее песочница посылает сообщение обратно в основное приложение, передавая объект снэпшота графа, предварительно топологически сортируя его узлы для правильной отрисовки →

-

основное приложение получает сообщение и отрисовывает UI графа, используя данные из объекта снэпшота.

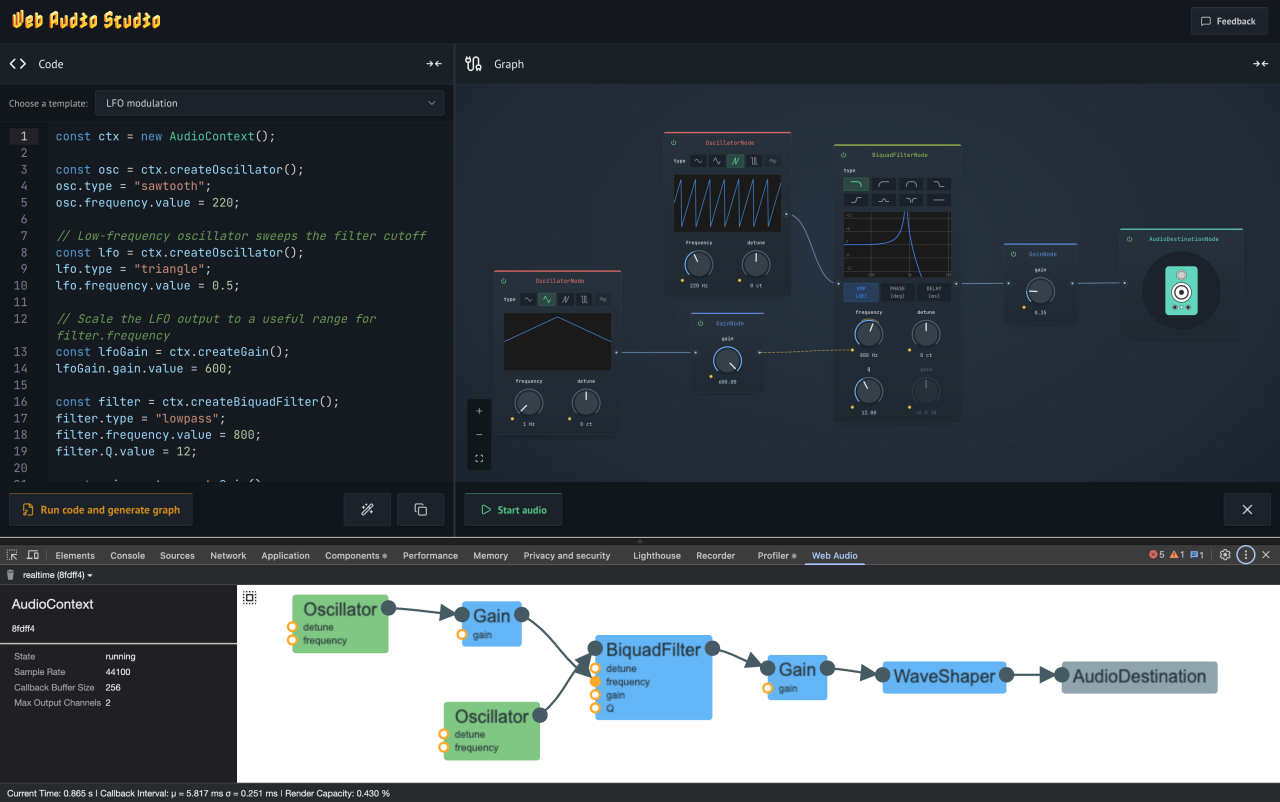

Визуализация аудиографа

Когда основное приложение получает снэпшот, его нужно превратить в интерактивную визуализацию. Для отрисовки графа я использую библиотеку React Flow, которая рендерит узлы и рёбра как полноценные React-компоненты с интерактивными контролами, анимациями и визуализациями внутри. Позиционирование узлов на экране вычисляется автоматически библиотекой Dagre, которая предоставляет алгоритм для раскладки направленных графов. Раскладка вычисляется в Web Worker, чтобы не блокировать основной поток при сложных графах.

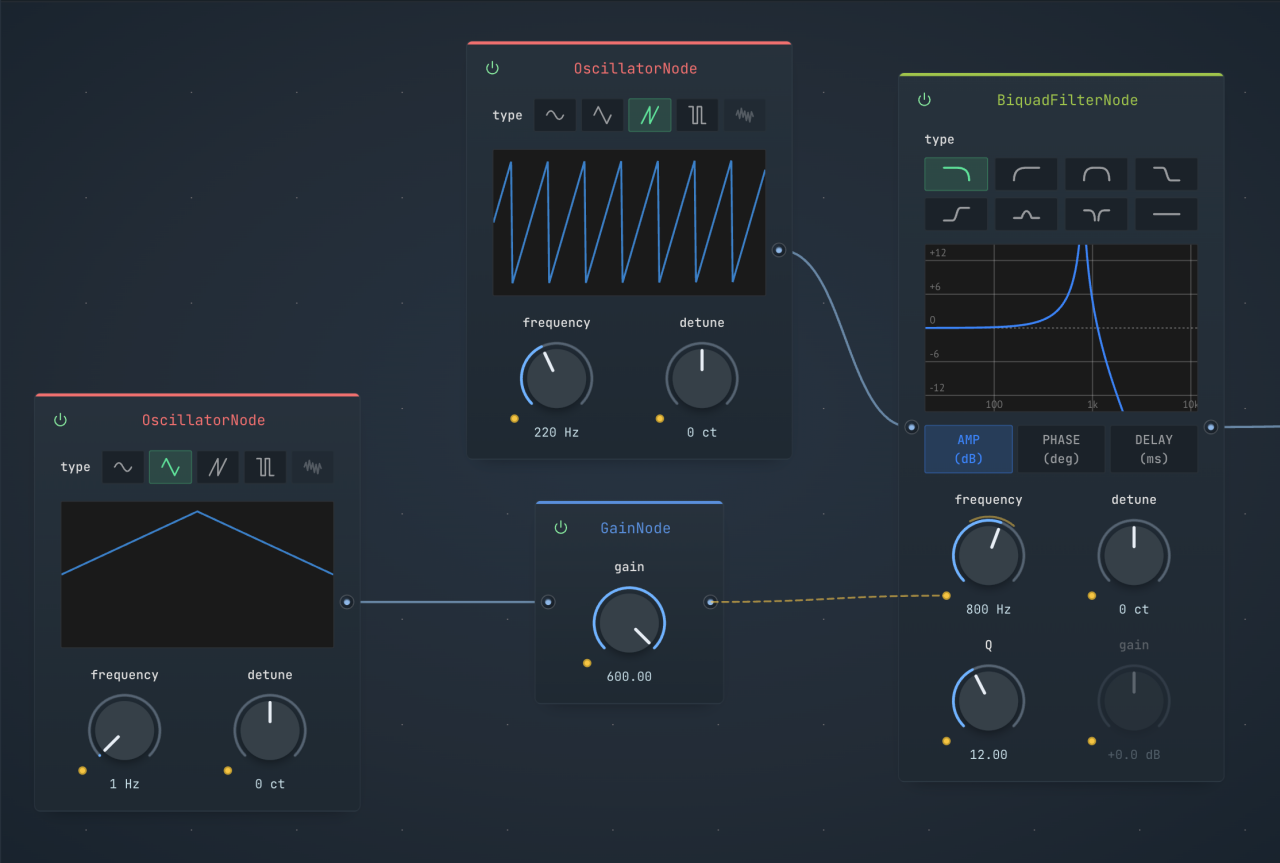

Узлы сгруппированы функционально и закодированы цветами — это заметно упрощает навигацию по сложным графам:

Соединения (рёбра) между узлами в Web Audio API могут быть двух видов:

-

Audio edges — путь, по которому течёт аудиосигнал, он задаётся через

osc.connect(gain); -

Control edges — пути модуляции аудиопараметров, когда один узел управляет параметром другого:

lfo.connect(osc.frequency).

В Web Audio Studio аудиорёбра отображаются сплошными голубыми линиями, а рёбра модуляции — пунктирными жёлтыми. Такое визуальное разделение позволяет сразу понимать, где в графе проходит реальный звук, а где идёт управление его параметрами.

Интерактивность и изменение параметров в рантайме

Главная образовательная ценность Web Audio Studio состоит в том, что сгенерированный граф можно менять вручную и сразу слышать результат. Каждый аудиопараметр в узле представлен соответствующей крутилкой. Когда пользователь крутит ручку (например, частоту осциллятора), UI посылает соответствующее сообщение в песочницу. Там этот параметр меняется прямо в рантайме через ссылку на инстанс узла:

const handleParamChange = (msg) => {

const { nodeId, paramName, value } = msg.payload;

const node = audioNodeRegistry.getNodeById(nodeId);

const param = Reflect.get(node, paramName);

const now = ctx.currentTime;

param.cancelScheduledValues(now);

param.setValueAtTime(param.value, now);

param.linearRampToValueAtTime(value, now + 0.04);

};

Обратите внимание на вызов linearRampToValueAtTime() вместо прямого присваивания param.value = .... Это классическая техника из мира DSP — она позволяет предотвратить артефакты, которые возникают при резком скачке значения аудиопараметра. Без неё изменение частоты крутилкой звучало бы как серия дискретных щелчков вместо плавного перехода.

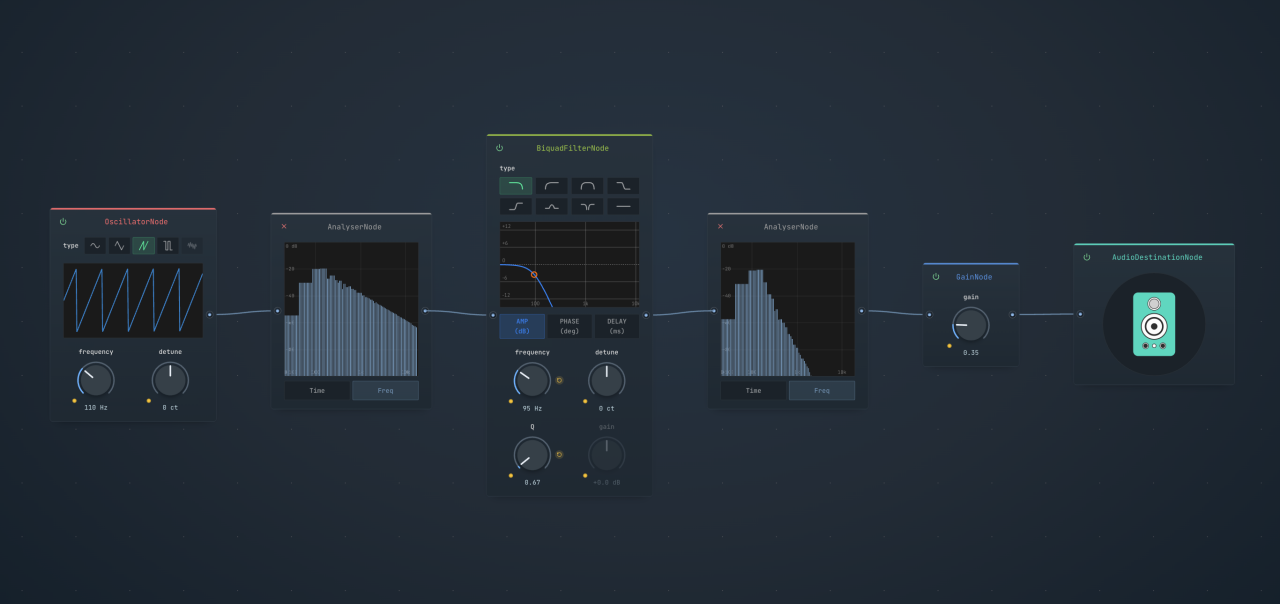

Вставка анализатора на лету

Крайне полезная фича, реализованная в Web Audio Studio — это возможность вставить анализатор между любыми двумя узлами, просто кликнув по их ребру. Это позволяет проинспектировать сигнал в любой точке графа через встроенный в узел анализатора осциллограф или спектроанализатор.

AnalyserNode в Web Audio API предоставляет данные двух видов: значения относительно time domain (режим осциллографа) и frequency domain (режим спектрографа). Эти данные собираются в песочнице и в рантайме передаются в основное приложение через Transferable-буферы. Такие буферы позволяют передавать данные из одного контекста в другой без копирования, что критично для производительности графа, особенно на 60 кадрах в секунду с несколькими подключенными анализаторами одновременно:

const msg = {

type: "analyser-data",

payload: {

entries,

timeDomainBuffer: timeDomainConcat.buffer,

frequencyBuffer: frequencyConcat.buffer,

},

};

// Transferable-буферы перемещаются, а не копируются

sendFn(msg, [timeDomainConcat.buffer, frequencyConcat.buffer]);

Это лишь часть инженерных решений, к которым я пришёл в процессе разработки Web Audio Studio. Далее я бы хотел немного шире посмотреть на сам стандарт Web Audio API и на то, почему веб-аудио экосистеме очень не хватает таких инструментов, как Web Audio Studio.

Размышления о стандарте Web Audio API

Web Audio API — один из самых мощных низкоуровневых стандартов веб-платформы. Он позволяет в реальном времени синтезировать звук из математических функций, строить произвольные цепи обработки, работать с пространственным звуком, писать собственные DSP-алгоритмы через AudioWorkletNode и анализировать частотный спектр. Всё это доступно прямо в браузере, без плагинов и с нативной производительностью. По сути, это встроенный в браузер аудиодвижок уровня профессионального DAW.

И при всём этом WAA остаётся нишевым стандартом. Большинство фронтенд-разработчиков имеют о нём лишь поверхностное представление, а музыкальные и аудио-приложения в вебе можно пересчитать по пальцам. Почему так происходит?

Самый очевидный ответ — высокий порог входа в DSP. Это правда, но это лишь часть проблемы. Порог входа в 3D-графику тоже высок, однако тот же WebGL породил целую экосистему: Three.js, Babylon.js, PlayCanvas, десятки визуальных редакторов, развитую документацию и активные сообщества разработчиков. В веб-аудио сопоставимого масштаба экосистемы так и не появилось. Есть Tone.js и Web Audio Modules (о которых вообще почти никто не знает), но инфраструктуры всё ещё заметно не хватает.

На мой взгляд, ключевая причина недооценённости Web Audio API — это отсутствие удобных инструментов для разработки и отладки. Представьте, что вы разрабатываете WebGL-приложение, но у вас нет визуального инспектора: вы не видите сцену, не можете кликнуть по объекту и посмотреть его свойства. Есть только код и console.log. В реальных аудиопроектах разработка часто сводится к попыткам на слух понять, где именно ломается цепь.

Для Chrome DevTools существует расширение Audion , которое схематично отображает граф узлов и их соединения. Однако этот инструмент показывает только статичную топологию: узлы и рёбра без значений параметров, без визуализации сигнала и без возможности что-то изменить. По сути, это тот же console.log, только в графическом виде. К тому же поддержка расширения сейчас минимальная.

Когда вы отлаживаете аудиограф, вам могут понадобиться ответы на вопросы, которые почти невозможно получить напрямую из кода:

-

Что сейчас звучит и почему? Какие узлы активны, какие значения у параметров в данный момент, а не в момент вызова

console.log? -

Где в цепи возникают проблемы или искажения? Как увидеть и начать исследовать сигнал между двумя узлами?

-

Что произойдёт, если изменить значение конкретного параметра? Как покрутить его и сразу услышать результат, не переписывая код и не перезагружая страницу?

-

Правильно ли собран аудиограф? Как увидеть его топологию, включая циклические связи, а не держать её в голове?

Ни один из существующих инструментов не позволяет полноценно ответить на эти вопросы о вашем коде. Визуальные конструкторы аудиографов позволяют собрать граф мышкой, но работают со своими абстракциями и почти не помогают в реальной разработке. Вы не можете взять собственный AudioContext и свою логику построения графа и просто увидеть результат.

Web Audio Studio — это попытка создать инструмент, который мне самому хотелось иметь 15 лет назад. Его философия строится на трёх принципах:

-

Код первичен. Граф не собирается из визуальных модулей. Вы пишете обычный JavaScript, который затем можно перенести в свой проект.

-

Связь с рантаймом обязательна. Каждая крутилка в UI связана с реальным AudioParam в реальном

AudioContext. Это не симуляция и не приближение, а прямое 1:1 отражение состояния системы. -

Понимание важнее сборки. WAS задуман не как инструмент продакшена, а как инструмент для понимания аудиографов. Вставка анализатора в любую точку графа, временное исключение (bypass) узла из цепи или возможность мгновенно изменить любой параметр нужны прежде всего для исследования поведения системы.

Чего не хватает самому стандарту Web Audio API

Работая над Web Audio Studio, я не раз задумывался о том, что могло бы измениться в самом стандарте, чтобы вокруг него появилась более живая экосистема. Вот пара моих предложений на этот счёт:

-

Интроспекция графа. Сейчас

AudioContextне предоставляет способа узнать, какие узлы в нём созданы и как они соединены. Если бы существовал метод вродеgetActiveNodes()или событие типаonnodeconnect, инструменты вроде WAS стали бы проще, надёжнее и точнее. -

Читаемость непрозрачных объектов.

IIRFilterNodeне позволяет получить свои коэффициенты после создания, PeriodicWave — прочитать гармоники. В результате их приходится перехватывать в момент создания. Хотелось бы также иметь возможности для инспектирования данных в этих интерфейсах в рантайме. -

Стандартизированный debug-протокол. Подобно Chrome DevTools Protocol, который даёт инструментам доступ к DOM, сети и производительности, аналогичный протокол для Web Audio позволил бы создавать мощные расширения, плагины для IDE и standalone-инспекторы.

Но даже без изменений в стандарте пространство для инструментов остаётся огромным. Мне хочется верить, что Web Audio Studio станет одним из шагов к тому, чтобы разработчики начали воспринимать Web Audio не как нишевый и загадочный API, а как мощную и понятную систему для работы со звуком в вебе.

Заключение

Если вы работаете с Web Audio API, делаете музыкальные или интерактивные приложения, экспериментируете со звуком или только присматриваетесь к этой области — попробуйте Web Audio Studio и посмотрите, окажется ли он полезным в вашей работе.

Я планирую развивать этот инструмент дальше и добавлять всё более продвинутые фичи для разработки и исследования аудиографов. Мне было бы особенно интересно узнать, как вы отлаживаете сложные аудиографы в реальных проектах, какие инструменты используете и чего вам не хватает сегодня. Если захотите поделиться опытом, мыслями или предложениями по развитию проекта — пишите в комментариях, в личные сообщения или на почту contact@webaudio.studio .

Ссылка на Web Audio Studio: https://webaudio.studio

Приглашаю вас подписаться на мой телеграм-канал: https://t.me/alexgriss , где я пишу о фронтенде, архитектуре, UX/UI, продакт-мышлении, стартапах и лидерстве, а также выкладываю новости о развитии Web Audio Studio и рассказываю о Web Audio API и работе со звуком в браузере.